2025年10月28日,十四届全国人大常委会第十八次会议审议通过关于修改《中华人民共和国网络安全法》的决定。新修改的《网络安全法》(以下称“《修改稿》”)将于2026年1月1日起施行。这是2016年《网络安全法》出台以来的首次修改。《网络安全法》(以下称“原法”)与《数据安全法》《个人信息保护法》一并构成我国网络法领域的顶层设计。而《网络安全法》出台远早于《数据安全法》和《个人信息保护法》,且其内容详实,涉及网络信息安全、关键信息基础设施安全、数据安全和个人信息保护等,是网络法治的起源和重要的上位法依据。

《网络安全法》是一部综合性、基础性、全面性的法律,对网络领域合规工作尤为重要,其修改工作受到社会各界广泛关注。从修改历程看,自2022年启动《网络安全法》修改工作以来,国家网信办两次向社会公开征求意见,分别发布了《关于修改<中华人民共和国网络安全法>的决定(征求意见稿)》(以下称“2022年修改稿”)[1]和《中华人民共和国网络安全法(修正草案再次征求意见稿)》(以下称“2025年修改稿”)[2];从修改内容看,《修改稿》更为科学、合理,以调整法律责任为主线,兼顾人工智能等发展趋势,首次从法律层面回应了人工智能治理的内容。

我们将系统梳理本次修改的内容,分次为大家进行全面解读。

总则条款的不变与变

《修改稿》对总则条款进行了增补,将总体国家安全观的内容写入,作为网络安全法治的基本指导,同时首次增加了人工智能条款,从法律层面框定了人工智能发展的基础规范。

1

明确总体国家安全观作为网络安全法治的基本指导

《修改稿》增加了一条作为第三条,网络安全工作坚持中国共产党的领导,贯彻总体国家安全观,统筹发展和安全,推进网络强国建设。总体国家安全观是党的历史上第一个被确立为国家安全工作指导思想的重大战略思想,是中国共产党和中国人民捍卫国家主权、安全、发展利益百年奋斗实践经验和集体智慧的结晶,是马克思主义国家安全理论中国化的最新成果,是习近平新时代中国特色社会主义思想的重要组成部分,是新时代国家安全工作的根本遵循和行动指南[3]。《网络安全法》作为网络安全甚至网络领域最为基础的法律,将总体国家安全观与网络安全基础法律相融合,体现了法治网络、法治安全的基本思路,也将是通过法律形式固化下来的长期准则。

2

回应人工智能治理发展需要

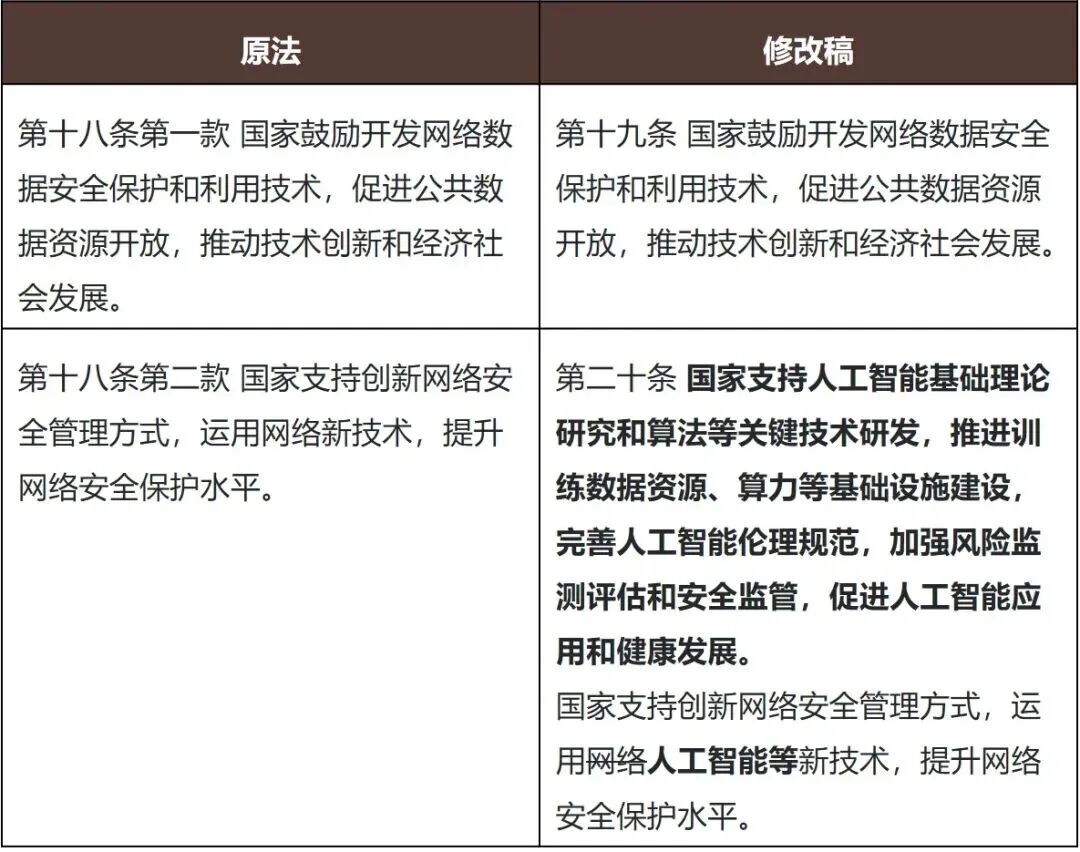

《修改稿》将原第十八条拆为两款,并增加一条作为第二十条。

《修改稿》第二十条首次在法律层面对人工智能作出规定。了解《网络安全法》的历史就会知道,《网络安全法》开创了诸多网络领域法律制度的先河。比如,《网络安全法》是互联网信息内容的唯一法律层级的上位法依据;《网络安全法》首先在法律位阶中规定个人信息保护问题,并成为《个人信息保护法》的制度渊源之一;《网络安全法》是数据跨境的最早法律规定。本次修改过程中,在最后审议阶段规定了人工智能相关内容,无疑释放了清晰的法治信号,意味着我国人工智能立法已经从法治计划走向具体立法层面。

“人工智能专条”虽然只有一条,但是高度凝练,涉及丰富的内容,包括四个方面:

(1)

强调基础支撑,“明确国家支持人工智能基础理论研究和算法等关键技术研发”。《国务院关于深入实施“人工智能+”行动的意见》(国发〔2025〕11号)中第一项重点行动就是“人工智能+”科学技术,要求加速科学发展进程,驱动技术研发模式创新和效能提升,创新哲学社会科学研究方法。该意见将“提升模型基础能力”列为八大基础支撑之一,明确加强基础理论研究,支持多路径技术探索和模型基础架构创新。《国务院办公厅关于加快场景培育和开放 推动新场景大规模应用的实施意见》(国办发〔2025〕37号)中要求在人工智能领域加强关键核心技术攻关和推广应用,加快高价值应用场景培育和开放,更好满足科技、产业、消费、民生、治理、全球合作等各领域发展需要。

(2)

明确资源供给,“确定推进训练数据资源、算力等基础设施建设”。训练数据对于人工智能特别是生成式人工智能尤为关键,而训练数据的合法性备受关注。《生成式人工智能服务暂行办法》中要求生成式人工智能服务提供者使用具有合法来源的数据和基础模型,涉及个人信息的应当取得个人同意或者符合法律、行政法规规定的其他情形。实践中,生成式人工智能高度依赖海量训练数据,数据来源合法性常常成为合规实务的难点问题。《修改稿》的这一规定,可以理解为是对训练数据活动的肯定,只要符合法律相关合规要求,即能够开展相关活动。同时,训练数据本身也被视为一种资源,成为人工智能发展的基础设施之一。

(3)

确定伦理规范,“完善人工智能伦理规范”。国内已建立起多层次的人工智能伦理规范体系,形成治理框架和重点风险防控思路。《新一代人工智能伦理规范》(2021年)作为国家新一代人工智能治理专业委员会发布的核心伦理文件,提出6项基本伦理要求和18项具体伦理要求;《关于加强科技伦理治理的意见》(2023年)提出伦理先行、依法依规、敏捷治理等治理原则,要求将科技伦理要求贯穿科学研究、技术开发等科技活动全过程,加快推进科技伦理治理法律制度建设,加强科技伦理风险预警与跟踪研判等;《科技伦理审查办法(试行)》(2023年)要求从事生命科学、医学、人工智能等科技活动的单位,研究内容涉及科技伦理敏感领域的,应当设立科技伦理(审查)委员会,对相关科技活动进行科技伦理审查;《人工智能科技伦理管理服务办法(试行)(公开征求意见稿)》(2025年)明确了人工智能科技活动的伦理要求,帮助企业切实提升科技伦理风险防范能力。

《修改稿》首次在法律中明确提出人工智能伦理规范,势必将成为后续人工智能相关立法的重要渊源和主要依据。同时,由《网络安全法》来首次规定人工智能治理的内容,也反映出安全因素在当前人工智能发展阶段的重要性,宜在合规层面重视安全保障能力。

(4)

风险治理路径,“加强风险监测评估和安全监管”。《修改稿》明确了风险治理的思路,即根据风险高低设置不同的责任义务。风险治理思路在欧盟《人工智能法》(AIA)中体现得十分明显,其将人工智能划分为高、中、低等不同等级,对高风险人工智能系统规定了严格的合规义务,以防止其产生破坏性风险。我国在相关政策文件中亦初步形成了风险治理的思路,《新一代人工智能伦理规范》第八条要求加强风险防范,增强底线思维和风险意识,加强人工智能发展的潜在风险研判,及时开展系统的风险监测和评估,建立有效的风险预警机制,提升人工智能伦理风险管控和处置能力。《修改稿》作为法律文件对风险思路予以确定,反映出未来相当长时间内我国治理人工智能的基本态度和法治路径。

此外,《修改稿》不仅明确治理人工智能,也要求运用人工智能治理,第二十条第二款修改增加人工智能等新技术作为网络安全管理创新方式,代表了未来监管方式改革的趋势,更加反映出数字经济时代新型监管特点。

来源:网信扬州